SEO con IA es la aplicación de modelos de lenguaje, machine learning y automatización inteligente a los procesos de posicionamiento en buscadores: desde la investigación de palabras clave hasta la auditoría técnica y la creación de contenido. No consiste en publicar más deprisa. Consiste en construir mejores sistemas para research, contenidos y auditorías, con menos fricción y sin degradar la calidad. Esa diferencia —proceso sobre velocidad— es la que separa una implementación seria de una colección de prompts sueltos.

Publicar más no equivale a posicionar mejor. Automatizar más no equivale a trabajar mejor. Y tener una herramienta nueva no significa haber construido un sistema. La pregunta útil no es si la IA sirve para SEO —sirve, en tareas concretas, con condiciones concretas. La pregunta útil es dónde la IA aporta una ventaja real, dónde introduce riesgo y cómo crear procesos para capturar lo primero sin arrastrar lo segundo.

¿Qué es hacer SEO asistido con IA y por qué importa ahora?

El SEO con IA tiene dos dimensiones que conviene no mezclar:

- La primera es operativa: usar modelos de lenguaje y herramientas de automatización para hacer más eficientes las tareas habituales del SEO —keyword research, briefs, QA, auditorías, reporting.

- La segunda es estratégica: optimizar el contenido para que sea citado por los propios sistemas de IA —Google AI Overviews, ChatGPT, Perplexity— en sus respuestas generativas.

Ambas dimensiones son reales y complementarias. Ignorar cualquiera de las dos es quedarse con la mitad del mapa. El SEO de 2026 cubre más superficies que nunca: rankear en Google sigue siendo el trabajo central, y aparecer cuando un usuario le pregunta algo a un LLM es ya parte del mismo trabajo.

Los datos del contexto son contundentes: los AI Overviews de Google aparecen ya en el 48% de las búsquedas en febrero de 2026, frente al 13% de principios de 2025 —una expansión de casi cuatro veces en doce meses. Cuando aparece un AI Overview, el CTR orgánico cae un 61% de media —de 1,76% a 0,61%— según el estudio de Seer Interactive (septiembre 2025). Y el 75% de los profesionales del marketing ya usa herramientas de IA en alguna parte de su trabajo, según distintos estudios de 2025. La adopción no es una tendencia emergente. Es el estándar.

Qué tareas SEO merece la pena acelerar con IA

La IA da mejor resultado en tareas con mucho volumen, mucho patrón repetido y mucha necesidad de clasificar información. Donde peor funciona es donde el criterio estratégico o el contexto de negocio son imprescindibles.

Research y clustering de keywords

Procesar un export de 2.000 keywords, agruparlas por intención semántica y detectar huecos de cobertura es uno de los trabajos más mecánicos del SEO. Un sistema bien configurado lo transforma en horas lo que manualmente llevaría días.

El flujo más directo: exporta tus queries de Search Console / ahrefs / Semrush, pásalas a Codex / Claude y pídele clustering por intención.

Este es un prompt probado para hacer clustering desde un export de GSC:

Aquí tienes un listado de queries extraídas de Google Search Console de los últimos 90 días.

Cada fila tiene: query | clics | impresiones | CTR | posición media.

Tu tarea:

1. Agrupa las queries en clusters semánticos. Cada cluster debe compartir intención de búsqueda y entidad principal.

2. Ponle un nombre corto y descriptivo a cada cluster.

3. Indica la intención dominante: informacional / comercial / transaccional / navegacional.

4. Señala cuál es la query "cabeza" de cada cluster (la más representativa y con más potencial).

5. Marca con [HUECO] los clusters donde detectes que probablemente no existe una página en el sitio.

6. Ordena los clusters de mayor a menor potencial según: volumen de impresiones + intención comercial.

Formato de salida: tabla con columnas | Cluster | Intención | Query cabeza | Queries del grupo | Hueco |

Queries:

[ENLAZA AQUÍ EL FICHERO EXPORT CSV DE GSC]El output de este prompt es una lista priorizada lista para convertirse en calendario editorial. Ninguna herramienta especializada te da más control sobre el resultado que definir tú mismo los criterios de agrupación.

Briefing y outlines

La IA puede convertir una keyword en un brief estructurado con ángulo editorial, preguntas a responder, estructura de H2/H3 propuesta y FAQs basadas en People Also Ask. Su valor está en acelerar el arranque, no en publicar el primer output sin revisar.

Claude con un prompt bien construido cubre el 90% de esto: analiza la intención de búsqueda, identifica qué subtemas deben aparecer y propone una estructura inicial. Hay herramientas especializadas como Frase o Content Harmony que automatizan la comparativa SERP, pero su coste se justifica principalmente en equipos con volumen alto de producción y bajo expertise en diseñar y mejorar procesos agénticos.

En un flujo agéntico, el brief se genera sin pegar datos a mano. Un subagente consulta la SERP API con la keyword y extrae posición, título, URL y snippet de los primeros resultados; otro subagente visita cada URL del top 5 y extrae la estructura de headings y el conteo de palabras. El orquestador recibe ambas salidas y genera el brief completo.

Eres el orquestador de un análisis competitivo SEO para generar un brief.

Keyword objetivo: "[TU KEYWORD]"

Tienes dos subagentes disponibles:

— Subagente SERP: recibe una keyword, consulta la SERP API y devuelve los 10 primeros resultados (posición, título, URL, snippet).

— Subagente de contenido: recibe una lista de URLs y devuelve, para cada una, la estructura de headings (H1 > H2 > H3) y el conteo de palabras aproximado.

Flujo de ejecución:

1. Llama al subagente SERP con la keyword.

2. Pasa las 5 primeras URLs al subagente de contenido.

3. Con ambas salidas, genera un brief que incluya:

- Intención de búsqueda principal y secundarias detectadas

- Subtemas que cubre la competencia y que NO puedo ignorar

- Ángulos que la competencia NO cubre (mi oportunidad de diferenciación)

- Estructura de H2/H3 recomendada para mi artículo

- 3-5 FAQs que el lector objetivo probablemente tiene

- Longitud aproximada recomendada basada en lo que ya rankea

- Tipo de formato dominante: guía paso a paso, lista, comparativa, definición + ejemplos...

Sé específico. No generes un brief que podría servir para cualquier sitio.QA editorial

El QA editorial es la fase de revisión estructurada que ocurre entre el borrador y la publicación. Su función no es reescribir: es detectar los problemas que pasan desapercibidos cuando escribes sección por sección. Relleno que dilata el artículo sin añadir valor, ideas que se repiten en puntos distantes del texto, afirmaciones sin respaldo que no superarían un fact-check básico, o un cierre que simplemente resume en lugar de impulsar una acción. Un modelo de lenguaje procesa el artículo completo de una vez, lo que lo convierte en un revisor eficiente para los patrones que un humano pierde por fatiga de lectura.

Lo que la IA no puede hacer bien en QA: verificar si el tono encaja con la voz de marca, evaluar si la estrategia es correcta para el negocio, o detectar con fiabilidad si un dato es factualmente incorrecto. Esas tres cosas requieren humano.

Un prompt de QA tipo juez, con puntuaciones por dimensión:

Eres un juez editorial SEO. Evalúa el artículo adjunto con criterios específicos y objetivos.

Para cada dimensión: asigna una puntuación de 1 a 10, cita evidencia literal del texto y propón una corrección concreta si la puntuación es inferior a 8.

KEYWORD OBJETIVO: "[TU KEYWORD]"

---

1. INTENCIÓN DE BÚSQUEDA [1-10]

¿El artículo responde completamente la query o se desvía en algún punto?

→ Puntuación: X/10

→ Evidencia: [cita literal del problema, si existe]

→ Corrección: [qué cambiar]

2. DENSIDAD INFORMATIVA [1-10]

¿Hay frases o párrafos que no aportan información nueva y podrían eliminarse sin pérdida?

→ Puntuación: X/10

→ Evidencia: [fragmento literal]

→ Corrección: [eliminar o condensar así]

3. COHERENCIA INTERNA [1-10]

¿Se repite alguna idea en distintas secciones del artículo?

→ Puntuación: X/10

→ Evidencia: [las dos instancias donde aparece]

→ Corrección: [cuál eliminar o cómo fusionar]

4. ARRANQUE [1-10]

¿La introducción llega al punto antes de las 100 palabras?

→ Puntuación: X/10

→ Evidencia: [primera frase que no aporta valor al inicio]

→ Corrección: [cómo acortar la entrada]

5. RESPALDO FACTUAL [1-10]

¿Hay afirmaciones fuertes sin dato, fuente o ejemplo concreto que las respalde?

→ Puntuación: X/10

→ Evidencia: [afirmación sin respaldo]

→ Corrección: [qué tipo de dato o fuente añadir]

6. CIERRE ACCIONABLE [1-10]

¿La conclusión termina con algo que el lector puede hacer, o simplemente resume?

→ Puntuación: X/10

→ Evidencia: [última frase del artículo]

→ Corrección: [cómo convertirla en accionable]

7. PROMESA DEL TÍTULO [1-10]

¿El contenido cumple exactamente lo que promete el H1? ¿Hay secciones que no tienen relación directa?

→ Puntuación: X/10

→ Evidencia: [sección o párrafo que no encaja]

→ Corrección: [eliminar, reorientar o reescribir el H1]

---

VEREDICTO FINAL

Puntuación total: XX/70

Diagnóstico en una línea: [el problema principal que tiene este artículo]

Acción prioritaria: [la única cosa que, si se corrige, tiene más impacto en calidad y posicionamiento]

[PEGA EL ARTÍCULO AQUÍ]Este prompt funciona mejor después de escribir el borrador completo, no sección por sección. El modelo necesita ver el conjunto para detectar repeticiones entre partes distantes del texto.

Auditoría y detección de patrones

Un caso concreto que ilustra el valor real: tomar un export de Search Console con 300 URLs de bajo rendimiento, pasarlo a Claude con un prompt de categorización, y recibir agrupaciones como «87 páginas con CTR por debajo del 1% en posiciones 4-10 —candidatas a mejorar el title tag—» o «34 páginas sin impresiones en los últimos 90 días —revisar indexación o considerar consolidación». Lo que manualmente requeriría analizar fila por fila, el sistema lo procesa y categoriza en pocos minutos.

El flujo estándar: exportación de Screaming Frog o GSC → análisis con Claude o Codex → agrupación por patrón → output priorizado en Google Sheets. Para perfiles técnicos, Screaming Frog + script Python + Claude API permite automatización completa. Si el corpus incluye documentos, PDFs o fuentes no estructuradas, Docling aplicado al SEO resuelve esa capa de ingestión. Las herramientas de IA aplicadas a auditoría ahorran entre 10 y 80 horas mensuales en equipos medianos.

El prompt de categorización que produce ese tipo de output:

Aquí tienes un export de Google Search Console con el rendimiento de URLs en los últimos 90 días.

Columnas: URL | Clics | Impresiones | CTR | Posición media

Tu tarea es categorizar cada URL en uno de estos grupos de acción:

MEJORAR TITLE/META — URLs con posición media entre 4 y 15 y CTR por debajo del 2%. El contenido puede estar bien posicionado pero el título no convence al clic.

REVISAR CONTENIDO — URLs con muchas impresiones pero posición media por encima de 15. El contenido existe pero no compite. Puede necesitar más profundidad o mejor estructura.

CONSOLIDAR O RETIRAR — URLs con menos de 50 impresiones en 90 días. Evalúa si tienen algún enlace interno que justifique mantenerlas o si es candidata a consolidación con otra URL.

QUICK WIN — URLs en posición 11-20 con volumen de impresiones relevante. Son las más cercanas a la primera página con menor esfuerzo.

SIN ACCIÓN URGENTE — el resto.

Para cada URL de las categorías MEJORAR TITLE y QUICK WIN, añade en una línea la acción concreta recomendada.

Formato de salida: tabla | URL | Categoría | Acción |

[PEGA AQUÍ EL EXPORT CSV DE GSC]Con 200-300 URLs el resultado llega en menos de un minuto. Con volúmenes mayores, parte el export en bloques de 300 filas y pide al modelo que unifique los patrones al final.

Hay un paso más que vale la pena mencionar: con Claude o Codex puedes construir el 70% de lo que hace Screaming Frog sin instalar nada. Un crawler básico en Python que recorre las URLs de un sitemap, extrae title, H1, meta description, código de respuesta y enlaces internos se escribe en 30-40 líneas. Añade una capa de análisis con la API de Claude y tienes un auditor personalizado que hace exactamente lo que tú necesitas —sin los límites de la versión gratuita de Screaming Frog y sin el coste de la licencia.

Con Claude o Codex puedes programar también el renderizado JavaScript —via Playwright o Puppeteer— y el análisis de logs de servidor. A efectos prácticos, no hay función de Screaming Frog que un script propio no pueda cubrir: crawl estático, extracción de metadatos, detección de redirecciones, análisis de enlaces internos, renderizado JS y parsing de logs. La ventaja real es que adaptas cada pieza a tu flujo exacto sin depender de exportaciones manuales ni de los límites de ninguna licencia.

Si esto te interesa, puedo escribir un artículo completo sobre cómo construir tu propio auditor SEO con Python y Claude desde cero: qué funciones cubrir primero, cómo estructurar el output para que sea accionable y cómo conectarlo con GSC. Deja un comentario si quieres que lo publique.

Qué tareas no deberías automatizar del todo

Verificación factual

Los modelos de lenguaje alucinan. No es un defecto que se vaya a resolver en la próxima versión: es una característica estructural de cómo funcionan. Si un modelo redacta una estadística, una comparativa técnica o una conclusión sin validación humana, te expones a publicar datos incorrectos que después cuestan mucho más de corregir —en credibilidad, en tiempo y a veces en SEO.

La regla práctica: cualquier dato numérico, cita o afirmación factual generada por IA debe verificarse contra una fuente primaria antes de publicarse. No como excepción. Como norma.

Priorización estratégica

La IA puede sugerir qué keywords tienen más volumen o qué artículos están perdiendo tráfico. Pero decidir qué cluster merece los recursos del equipo este trimestre, qué batalla competitiva no compensa librar o qué contenido se alinea mejor con la estrategia de negocio: eso requiere contexto que el modelo no tiene. El contexto de negocio —qué está intentando conseguir la empresa, cuáles son sus restricciones reales, qué relación tiene el contenido con el funnel— es irreemplazable.

Postura de Google sobre contenido IA

Google no penaliza el contenido generado por IA per se. Su posición oficial, expresada en Google Search Central desde 2023, es que el foco está en la calidad del contenido, no en cómo se produce. La frase exacta: «Our focus is on the quality of content, not how it’s produced.» Lo que sí penaliza es el contenido de baja calidad, el contenido masivo sin diferenciación, la ausencia de E-E-A-T y el contenido que no responde genuinamente a la necesidad del usuario. Publicar volumen de IA sin revisión no es una estrategia: es un riesgo.

Con qué trabajar: Claude, GSC y GA4 antes de pagar nada más

Antes de suscribirte a ningún SaaS de SEO, tienes tres fuentes de datos que probablemente no estás aprovechando bien: Google Search Console, Google Analytics 4 y un modelo de lenguaje como Claude. Con ese stack puedes cubrir el 80% del análisis SEO sin gastar nada adicional.

Los datos gratuitos que ya tienes

- Google Search Console: impresiones, clics, CTR y posición media por query y por URL, exportable en CSV. El dataset más valioso que existe sobre cómo Google ve tu sitio.

- Google Analytics 4: comportamiento real de usuario, sesiones, engagement, páginas de entrada y salida, conversiones. Combinado con GSC, permite ver qué atrae tráfico y qué convierte.

- Screaming Frog (hasta 500 URLs, gratis): crawl técnico completo —errores 404, redirecciones, titles duplicados, H1 ausentes, páginas sin canonical. Para sitios pequeños y medianos, la versión gratuita es suficiente.

- Claude o ChatGPT: el motor de análisis que convierte los datos anteriores en diagnóstico, clustering, briefs, QA y priorización. Sin él, los datos son tablas. Con él, son decisiones.

Cómo combinar GSC + GA4 en un solo prompt de diagnóstico

Exporta desde GSC el informe de rendimiento de los últimos 90 días (clics, impresiones, CTR, posición media por página). Exporta desde GA4 el informe de páginas con sesiones, engagement y conversiones. Combínalos en un prompt como este:

Aquí tienes dos exports de mi sitio web:

1. GSC (90 días): [pega el CSV con URL, clics, impresiones, CTR, posición media]

2. GA4 (90 días): [pega el CSV con página, sesiones, tasa de engagement, conversiones]

Analiza y responde:

- ¿Qué páginas tienen alto tráfico SEO pero baja tasa de engagement o conversión?

- ¿Qué queries tienen muchas impresiones pero CTR bajo? ¿Qué patrón de title podría mejorarlo?

- ¿Hay páginas con posición media entre 3 y 10 pero tráfico bajo? ¿Por qué puede ser?

- ¿Qué tres acciones priorizarías si solo pudieras hacer tres cambios este mes?

Responde con tablas cuando sea útil. Sé específico, no genérico.Este prompt cubre en un ciclo lo que muchos equipos tardan días en analizar manualmente. Ninguna herramienta de pago te da más que esto si haces bien la pregunta.

Los dos únicos pagos que se justifican

Con la base gratuita cubierta, hay dos herramientas de pago que sí justifican su coste cuando el volumen lo requiere:

- Un buen tracker de keywords: GSC no da seguimiento diario de posiciones ni comparativas históricas limpias. SE Ranking, Ahrefs o Semrush cubren esto. Si publicas con volumen o gestionas varios sitios, el tracking sistemático te ahorra tiempo y te avisa de cambios algorítmicos antes de que los veas en GSC. Si quieres evitar la suscripción mensual, en el blog tienes una guía para montar tu propio tracker de keywords en un NAS con coste casi cero. Si además quieres orquestar flujos de automatización desde ese NAS, tienes también la guía para instalar n8n en Synology sin necesitar Portainer.

- Un tracker de visibilidad en IA: herramientas como Otterly.ai, AthenaHQ o Profound monitorizan si tu marca aparece en respuestas de ChatGPT, Perplexity o Gemini. La idea es válida, pero hay que entender sus limitaciones antes de pagar: los LLMs dan respuestas diferentes ante el mismo prompt según el momento y la sesión —pequeños cambios de formulación pueden hacer que una marca aparezca o desaparezca. Las herramientas más básicas no detectan si la mención es positiva o incorrecta (Otterly, por ejemplo, marcó como «positivas» menciones con datos de empresa inventados en pruebas independientes). Y los precios son elevados para lo que entregan: AthenaHQ parte de 295$/mes. Si tu negocio depende de la visibilidad en IA generativa, vale la pena explorarlas. Si eres un proyecto pequeño o mediano, una alternativa más económica es montar un tracker personal de prompts: define 20-30 queries representativas de tu categoría, córrelas manualmente cada semana en ChatGPT y Perplexity, y registra los resultados en una hoja de cálculo. Más trabajo, pero más control y coste casi cero.

El resto de herramientas —Frase, Surfer SEO, Content Harmony, Keyword Insights— pueden acelerar flujos concretos, pero no son necesarias para hacer buen SEO con IA si tienes proceso claro y sabes usar bien los datos que ya tienes.

Workflow de keyword research con IA

Una de las mejores aplicaciones de la IA en SEO es convertir un export crudo de GSC o de cualquier herramienta de keywords en una lista de oportunidades con estructura real. No necesitas Keyword Insights ni SEMrush para esto: un CSV y Claude es suficiente para la mayoría de proyectos.

Paso 1: extraer y limpiar el export de GSC

Ve a GSC → Rendimiento → Búsqueda web → Exportar. Filtra por los últimos 90 días y descarga el CSV con queries, clics, impresiones, CTR y posición media. Antes de pasar los datos a Claude, limpia en Google Sheets: elimina queries de marca, borra filas con menos de 10 impresiones y separa las queries que ya tienen URL objetivo de las que no la tienen.

Paso 2: clustering semántico con Claude

Exporta desde GSC con las columnas: query, impresiones, clics, posición media y URL. Pégalo directamente en el prompt:

Eres un analista SEO especialista en arquitectura de contenidos. A continuación te paso queries extraídas de Google Search Console con sus métricas y la URL que ya las está atendiendo (si existe).

Tu tarea: agrupa estas queries en clusters semánticos y genera un plan de acción editorial.

CRITERIOS DE CLUSTERING:

- Agrupa por intención de búsqueda + entidad principal, no por similitud léxica superficial

- Una misma URL puede aparecer en varios clusters si rankea para intenciones distintas

- No hay límite fijo de queries por cluster; decide según coherencia semántica real

- Si una query puede pertenecer a dos clusters, asígnala al de mayor coincidencia de intención

PARA CADA CLUSTER DEVUELVE:

1. Nombre descriptivo del cluster

2. Intención: Informacional | Comercial | Transaccional | Navegacional

3. Tipo: Pillar (tema amplio, alta demanda) | Cluster (subtema específico)

4. Query cabeza: la query más representativa (mayor volumen o mayor precisión semántica)

5. Lista de queries agrupadas con sus métricas

6. URL actual: la URL que atiende este cluster, o [HUECO] si no existe

7. [CANIBALIZACIÓN]: si hay más de una URL distinta atendiendo queries de este mismo cluster, márcalo y lista las URLs en conflicto

8. Acción recomendada:

— CREAR: no existe URL para este cluster

— OPTIMIZAR: existe URL pero rankea fuera del top 10 o tiene CTR bajo respecto a su posición

— FUSIONAR: múltiples URLs compiten por el mismo cluster

— MANTENER: cluster cubierto y bien posicionado

RESUMEN FINAL (después de todos los clusters):

- Total de clusters identificados

- Número de [HUECO] detectados

- Número de [CANIBALIZACIÓN] detectadas

- Top 3 clusters prioritarios por volumen de impresiones agregado

DATOS (formato: query | impresiones | clics | posición media | URL o "sin URL"):

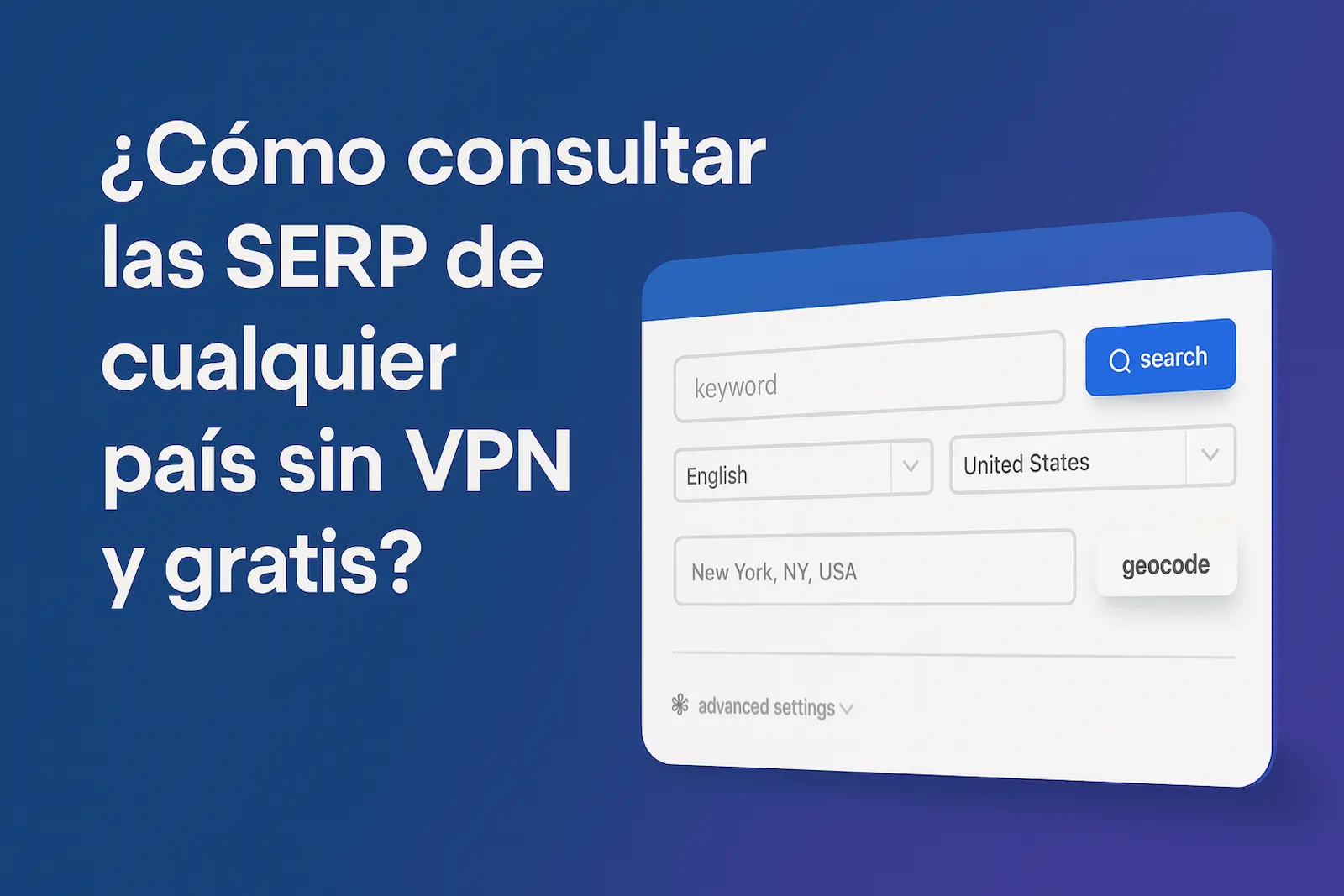

[PEGA AQUÍ]Paso 3: validar la intención en el SERP antes de producir

Antes de producir contenido para un cluster, comprueba qué tipo de resultado domina la SERP: artículo, comparativa, página de producto, herramienta, vídeo. Si el SERP quiere una comparativa y tienes planificado un artículo informacional, el problema no está en las keywords. Puedes consultar las SERP sin VPN para hacer esta validación antes de producir. Una vez tienes los resultados visibles, pásalos a Claude para que valide la intención y te diga si tu plan encaja:

Eres un analista SEO especialista en intención de búsqueda. Analiza los resultados del top 10 para esta keyword y valida si el contenido que tengo planificado encaja con lo que el SERP está pidiendo.

KEYWORD: "[TU KEYWORD]"

TIPO DE CONTENIDO QUE TENGO PLANIFICADO: [artículo informacional / comparativa / guía paso a paso / página de producto / herramienta / otro]

RESULTADOS DEL TOP 10 (posición | URL | tipo de página | título):

[PEGA AQUÍ LOS 10 RESULTADOS]

SEÑALES DEL SERP QUE OBSERVAS:

- Featured snippet: [¿existe? tipo: definición / lista / tabla / paso a paso]

- People Also Ask: [preguntas visibles]

- Otros elementos: [vídeo, imágenes, local pack, knowledge panel, shopping...]

- Fechas visibles: [contenido reciente o evergreen]

ANÁLISIS QUE NECESITO:

1. INTENCIÓN DOMINANTE

- ¿Qué tipo de resultado ocupa el top 5? ¿El SERP es uniforme o hay mezcla de intenciones?

- Intención principal en una línea

2. SEÑAL DE FORMATO

- Formato que más rankea (guía larga, lista numerada, comparativa, pregunta-respuesta, definición...)

- ¿Hay featured snippet? ¿Qué formato exacto usa?

3. VALIDACIÓN DE MI PLAN

- ¿Mi tipo de contenido planificado encaja con lo que el SERP demanda?

- Si hay desajuste: ¿qué cambio concreto debo hacer antes de escribir?

4. DIFICULTAD COMPETITIVA

- ¿El top 10 lo ocupan medios generalistas, sitios especializados o hay huecos (Reddit, foros)?

- Estimación: ALTA / MEDIA / BAJA con una línea de justificación

5. RECOMENDACIÓN FINAL

- Producir tal como está planificado / Ajustar el formato / Replantear el ángulo

- Si ajustar o replantear: acción concreta en una líneaPaso 4: priorización editorial con contexto de negocio

Una vez tienes los clusters validados, pide a Claude que te ayude a priorizarlos con contexto real. Incluye las acciones recomendadas que generó el paso anterior (CREAR / OPTIMIZAR / FUSIONAR):

Eres un estratega SEO senior. Prioriza los clusters de keywords que te paso con criterios de negocio reales, no solo por volumen.

CLUSTERS (incluye: nombre | intención | volumen estimado | acción recomendada):

[PEGA LOS CLUSTERS CON SUS DATOS]

CONTEXTO DEL SITIO:

- Temática principal: [describe el sitio]

- Objetivo de negocio prioritario: [captación / conversión / autoridad temática / tráfico]

- Autoridad temática actual: [alta/media/baja en cada tema relevante]

- Recursos disponibles: [artículos/mes]

- Contenido existente más fuerte: [URLs clave del sitio si las tienes]

CRITERIOS DE PUNTUACIÓN (1-5 cada uno):

A. Alineación con el objetivo de negocio

B. Facilidad competitiva: ¿el top 10 lo dominan medios generalistas o sitios especializados con mucha autoridad?

C. Encaje con la autoridad temática actual: ¿ya rankeas en temas adyacentes o relacionados?

D. Volumen e impacto esperado en tráfico cualificado

E. Velocidad de retorno: ¿es un quick win (posición 11-20, contenido mejorable) o requiere construir autoridad desde cero?

PARA CADA CLUSTER DEVUELVE:

- Puntuación por criterio (A · B · C · D · E)

- Puntuación total sobre 25

- Nivel de prioridad: ALTA / MEDIA / BAJA

- Acción concreta recomendada

- Justificación en 1-2 líneas

Ordena el resultado de mayor a menor puntuación total en formato de tabla.Con este proceso, lo que antes tomaba días de análisis manual se hace en horas. Sin suscripciones adicionales: solo GSC, Google Sheets y Claude.

Workflow de contenido SEO con IA

Donde peor funciona la IA es cuando se le pide «escríbeme un artículo» y se publica casi sin tocar. Donde mejor funciona es dentro de un sistema con pasos definidos y revisión humana en los puntos clave. Este workflow te permite usar Claude para briefs, outlines y QA sin depender de ninguna herramienta de pago.

Paso 1: generar el brief desde la SERP real

Antes de escribir nada, analiza qué cubre el top 5 de la SERP para tu keyword objetivo. Copia los títulos, H2s y estructura de los primeros resultados y pásalos a Claude. Incluye también las señales SERP que ves en la página de resultados:

Eres un analista de contenido SEO. Tienes los datos del top 5 de la SERP para la query objetivo. Genera un brief específico y accionable, no un resumen genérico de lo que ya existe.

KEYWORD OBJETIVO: "[TU KEYWORD]"

DATOS DEL TOP 5 (por cada resultado: posición | URL | título | H1 | H2s | H3s relevantes | longitud aproximada):

[PEGA AQUÍ]

SEÑALES DEL SERP (marca las que apliquen):

- Featured snippet: [¿existe? ¿tipo: definición / lista / tabla / paso a paso?]

- People Also Ask: [preguntas que aparecen]

- Formato dominante: [guía, lista, comparativa, definición, herramienta...]

- Otros elementos: [vídeo, imagen, local pack, knowledge panel...]

ANÁLISIS QUE DEBES ENTREGAR:

1. INTENCIÓN DE BÚSQUEDA

- Intención principal (informacional / comercial / transaccional / navegacional)

- Intenciones secundarias detectadas en la SERP

- Job-to-be-done real: ¿qué necesita resolver o decidir el buscador?

2. COBERTURA OBLIGATORIA

- Subtemas presentes en 3 o más de los 5 resultados (no los puedes ignorar)

- Subtemas presentes solo en 1-2 resultados (indica si son señal o ruido)

3. OPORTUNIDAD DE DIFERENCIACIÓN

- Ángulos, perspectivas o datos que ningún resultado del top 5 cubre

- Preguntas del lector que la competencia responde mal o superficialmente

4. ESTRUCTURA RECOMENDADA

- H1 sugerido

- H2s con descripción breve de qué debe cubrir cada sección

- H3s donde aplique

- Sección optimizada para capturar el featured snippet (si existe)

5. ESPECIFICACIONES

- Rango de longitud justificado (no una media ciega, sino basado en lo que realmente rankea)

- 3-5 preguntas para sección de FAQs basadas en las PAA y en huecos detectados

- Tipo de contenido diferenciador que puede romper el patrón del SERP actual

Cada recomendación debe poder justificarse con un dato concreto del top 5.Paso 2: revisar y tensar el outline

Una vez tienes el outline generado o propuesto, usa Claude para tensionarlo antes de escribir. El modelo actúa como juez: puntúa cada dimensión y propone correcciones concretas:

Eres un juez editorial SEO. Evalúa el outline a continuación con criterios objetivos.

Para cada dimensión: asigna una puntuación de 1 a 10 y propón una corrección concreta si la nota es inferior a 8.

KEYWORD OBJETIVO: "[TU KEYWORD]"

URL DE DESTINO (si ya existe): [URL o "artículo nuevo"]

OUTLINE:

[PEGA EL OUTLINE COMPLETO]

---

1. COBERTURA DE INTENCIÓN [1-10]

¿El outline responde completamente la intención principal o hay secciones que se desvían?

→ Puntuación: X/10

→ Problema: [sección específica que no encaja]

→ Corrección: [eliminar, reorientar o reemplazar por]

2. EQUILIBRIO DE SECCIONES [1-10]

¿Hay secciones demasiado amplias que deberían dividirse, o demasiado finas que deberían fusionarse?

→ Puntuación: X/10

→ Problema: [sección concreta]

→ Corrección: [cómo reorganizar]

3. COBERTURA DE SUBTEMAS OBLIGATORIOS [1-10]

¿El outline cubre lo que el lector objetivo esperaría encontrar y que la competencia ya cubre?

→ Puntuación: X/10

→ Hueco: [subtema que falta]

→ Corrección: [dónde y cómo añadirlo]

4. RIESGO DE CANIBALIZACIÓN [1-10]

¿Alguna sección solapa temáticamente con otro artículo del sitio?

→ Puntuación: X/10

→ Riesgo: [sección + URL con la que solapa]

→ Corrección: [delimitar el scope o hacer mención + enlace interno]

5. FLUJO LÓGICO [1-10]

¿El orden de las secciones es el más útil para el lector? ¿Va de problema a solución según la intención?

→ Puntuación: X/10

→ Problema: [salto lógico o sección fuera de lugar]

→ Corrección: [nuevo orden propuesto]

6. SEÑALES DE EXPERIENCIA Y AUTORIDAD [1-10]

¿El outline incluye secciones donde demostrar experiencia propia, datos concretos o casos reales?

→ Puntuación: X/10

→ Hueco: [dónde falta una señal de experiencia o autoridad]

→ Corrección: [qué tipo de sección o elemento añadir]

---

VEREDICTO FINAL

Puntuación total: XX/60

Problema principal: [el defecto más grave en una línea]

Si la puntuación total es inferior a 45, devuelve una versión mejorada del outline completo.Paso 3: QA antes de publicar

Antes de enviar a WordPress, pasa el borrador por este juez de pre-publicación con Claude. Puntúa cada dimensión, cita el texto exacto y bloquea la publicación si la suma es inferior a 45:

Eres un juez editorial de pre-publicación SEO. Evalúa el artículo adjunto.

Para cada dimensión: puntuación de 1 a 10, cita literal del problema si existe, corrección concreta si la nota es inferior a 8.

KEYWORD OBJETIVO: "[TU KEYWORD]"

---

1. RESPUESTA A LA QUERY [1-10]

¿El artículo responde de forma completa y directa la intención de búsqueda principal?

→ Puntuación: X/10

→ Evidencia: [fragmento que se desvía o queda incompleto]

→ Corrección: [qué añadir o reorientar]

2. RELLENO [1-10]

¿Hay frases o párrafos que no aportan información nueva y pueden eliminarse sin pérdida?

→ Puntuación: X/10

→ Evidencia: [cita literal]

→ Corrección: [eliminar o condensar en]

3. REPETICIÓN DE IDEAS [1-10]

¿Se repite alguna idea en secciones distintas del artículo?

→ Puntuación: X/10

→ Evidencia: [las dos instancias]

→ Corrección: [cuál eliminar o cómo fusionar]

4. ARRANQUE [1-10]

¿La introducción llega al punto antes de 100 palabras o da rodeos innecesarios?

→ Puntuación: X/10

→ Evidencia: [primera frase prescindible]

→ Corrección: [cómo comprimir la entrada]

5. RIGOR FACTUAL [1-10]

¿Cada dato numérico o afirmación fuerte tiene fuente nombrada o ejemplo concreto que la respalde?

→ Puntuación: X/10

→ Evidencia: [afirmación sin respaldo]

→ Corrección: [tipo de fuente o dato que necesita]

6. CIERRE ACCIONABLE [1-10]

¿La conclusión termina con algo que el lector puede hacer ahora, o simplemente resume?

→ Puntuación: X/10

→ Evidencia: [última frase del artículo]

→ Corrección: [cómo convertirla en accionable]

7. CREDIBILIDAD [1-10]

¿Hay afirmaciones que suenan exageradas, genéricas o que no superarían un fact-check básico?

→ Puntuación: X/10

→ Evidencia: [afirmación problemática]

→ Corrección: [matizar, eliminar o respaldar con]

---

VEREDICTO FINAL

Puntuación total: XX/70

Diagnóstico en una línea: [el problema principal]

¿Publicable? SÍ (≥50) / REVISAR (35-49) / NO PUBLICAR (<35)

[PEGA EL ARTÍCULO AQUÍ]La diferencia entre publicar el primer output de IA y publicar el output revisado suele ser la diferencia entre un artículo que suena genérico y uno que posiciona. El modelo genera la estructura; el criterio editorial define la calidad.

Workflow de auditoría SEO con IA

La auditoría SEO con IA no consiste en pegar un crawl y rezar. Consiste en preparar los datos en el formato que el modelo puede procesar bien, hacer la pregunta correcta y saber interpretar el output. Los cuatro escenarios siguientes cubren los casos más habituales con prompts probados y output esperado para cada uno.

Escenario 1: construir tu propio crawler SEO con agentes

Preparación de datos: no necesitas ninguna herramienta externa. Con un agente construido en Python —requests + BeautifulSoup para sitios estáticos, Playwright para JavaScript— puedes extraer exactamente los mismos campos que cualquier crawler comercial: URL, status code, title, meta description, H1, conteo de palabras, indexabilidad, canonical y enlazado interno. El output va directo al modelo sin exportaciones manuales. Pídele a Claude que construya el script y lo ejecute: es trabajo de una tarde la primera vez, y un asset reutilizable en cualquier proyecto.

Eres un agente de auditoría SEO técnica completa. Rastrea el sitio indicado, extrae todos los datos relevantes y genera un informe de problemas priorizados por impacto real en rankings e indexación.

SITIO A RASTREAR: [URL_DEL_SITIO]

LÍMITE DE URLs: [ej: 500]

FASE 1 — CRAWL

Extrae para cada URL interna:

- URL, status code HTTP

- Title y longitud en caracteres

- Meta description y longitud en caracteres

- H1 (texto completo), número de H1s en la página

- Meta robots y X-Robots-Tag

- Canonical (URL declarada)

- Conteo de palabras aproximado

- Profundidad de crawl desde la URL raíz (número de clics desde home)

- Número de enlaces internos entrantes

- Tiempo de respuesta del servidor en ms

- Schema markup presente (tipos: Article, FAQ, BreadcrumbList, HowTo, Product...)

- Renderización JavaScript requerida (sí/no)

Ignora: CSS, JS, imágenes, fuentes. Incluye PDFs solo si tienen enlaces internos.

Para páginas con JS crítico: usa renderizado completo con Playwright.

FASE 2 — CLASIFICACIÓN

Clasifica cada URL en una de estas cuatro categorías:

CRÍTICO — bloquea indexación o destruye rankings:

- Status 4xx/5xx con enlaces internos entrantes (link equity desperdiciado)

- Páginas indexables sin H1 o con H1 duplicado en páginas distintas

- Canonical que apunta a URL diferente sin justificación (canibalización técnica)

- Páginas con "noindex" que acumulan enlaces internos significativos

- Redirects encadenados (3xx → 3xx → destino)

- Páginas estratégicas a profundidad >4 clics desde home

ALTO — impacto directo en rendimiento orgánico:

- Titles ausentes, duplicados, o con longitud >65 o <30 caracteres en páginas estratégicas

- Meta descriptions ausentes o duplicadas en páginas de categoría o pillar content

- Páginas indexables con <300 palabras que no son thin content intencionado

- Páginas sin schema markup relevante para su tipo de contenido

- Tiempo de respuesta >2000ms en páginas estratégicas

MEDIO — mejoras de señal SEO:

- Páginas estratégicas sin canonical explícito declarado

- URLs con parámetros de sesión o tracking indexables

- Páginas estratégicas a profundidad 4 que tienen tráfico relevante

- Estructura de headings ausente o inconsistente en páginas largas

BAJO — cosmético o marginal:

- Meta descriptions >155 caracteres con contenido relevante

- URLs con mayúsculas o guiones bajos en lugar de medios

- Schema markup presente pero con campos obligatorios incompletos

FASE 3 — OUTPUT

1. Resumen ejecutivo:

- Total de URLs rastreadas / indexables / bloqueadas

- Total de problemas por categoría

- % de páginas con schema markup (preparación para citabilidad en IA)

- Top 5 acciones de mayor impacto estimado

- Alertas: páginas con JS-only sin SSR (invisibles para GPTBot, Anthropic-AI), huérfanas sin ningún enlace interno

2. Tabla de hallazgos:

URL | Categoría | Problema detectado | Acción recomendada | Responsable (SEO / Dev / Automatizable)

Orden: CRÍTICO primero, luego por enlaces internos entrantes descendente.Output esperado: una tabla priorizada donde los 20-30 primeros ítems son los que mueven el SEO real. Lo habitual es que el 70% de los problemas críticos se concentren en menos del 10% de las URLs. A diferencia de una herramienta cerrada, un crawler propio se puede extender: añadir detección de Core Web Vitals, cruzar con la API de GSC en el mismo run, o enviar el informe directamente a tu sistema de tickets.

Escenario 2: diagnóstico de URLs desde Google Search Console

Preparación de datos: en GSC → Rendimiento → Páginas, exporta los últimos 90 días con columnas Página, Clics, Impresiones, CTR y Posición media. Elimina filas con menos de 50 impresiones para reducir ruido estadístico. El modelo trabaja bien con hasta 500 filas en texto plano o Markdown.

Eres un analista SEO especialista en diagnóstico de rendimiento orgánico. Analiza estos datos de GSC y clasifica cada URL en grupos de acción, considerando el impacto de los AI Overviews en los CTRs actuales.

CONTEXTO IMPORTANTE:

Los CTR medios han bajado estructuralmente en 2025 por los AI Overviews en SERPs informacionales. Un CTR bajo en posición 1-3 no siempre indica un problema del title: puede ser el efecto de un AI Overview activo en esa query.

BENCHMARKS CTR (ajustados a 2025 con AI Overviews activos):

- Posición 1-3: CTR esperado 5-15% (queries informacionales con AIO pueden ser <3%)

- Posición 4-10: CTR esperado 1-5%

- Posición 11-20: CTR esperado <1,5%

GRUPOS DE ACCIÓN:

GRUPO 1 — Quick win de CTR (reescribir title/meta):

Criterio: posición 4-15, impresiones altas, CTR claramente por debajo del benchmark de su posición

Señal de que el problema es el copy del snippet, no el contenido ni la posición.

GRUPO 2 — Mejorar contenido para subir posición:

Criterio: posición 8-25, impresiones relevantes, probablemente falta profundidad o hay desajuste de intención

Señal de contenido que rankea pero no convence al algoritmo de subirlo más.

GRUPO 3 — Investigar canibalización o problema técnico:

Criterio: posición media buena (1-7) pero CTR anormalmente bajo, o posición con oscilaciones amplias entre semanas

Señal de que hay varias URLs compitiendo por las mismas queries o un problema de canonical.

GRUPO 4 — Posible impacto de AI Overview (CTR estructuralmente bajo):

Criterio: posición 1-5, CTR <2%, impresiones altas, query de naturaleza informacional o definitoria

Acción: no es un problema de copy. Optimizar para citabilidad en AI Overview: añadir definiciones directas, listas estructuradas, schema FAQ.

GRUPO 5 — Contenido a consolidar o retirar:

Criterio: <5 clics y <30 impresiones en 90 días; o caída sostenida >50% sin correlación con actualización de algoritmo conocida

GRUPO 6 — Monitorizar sin acción:

Criterio: rendimiento estable dentro de rangos normales para su posición

PARA CADA URL DE LOS GRUPOS 1-4 DEVUELVE:

- Hipótesis de causa principal

- Acción concreta en una línea

- KPI para medir el efecto a 30 días

Ordena por grupo. Dentro de cada grupo, por impresiones descendente.

RESUMEN FINAL:

- Total de URLs por grupo

- Estimación de clics recuperables en Grupo 1 y 2 (impresiones × diferencia de CTR esperada)

- Número de páginas que probablemente necesitan optimización para AI Overviews (Grupo 4)

DATOS (Página | Clics | Impresiones | CTR | Posición media):

[PEGA AQUÍ]Output esperado: las URLs del Grupo 1 son tus quick wins — reescribir el title tag y la meta description puede recuperar CTR en semanas sin tocar el contenido. El Grupo 3 suele revelar problemas de canibalización o crawl budget que no aparecen en el crawl técnico.

Escenario 3: detección de canibalización semántica

Preparación de datos: necesitas dos fuentes combinadas. De GSC: exporta las queries con más impresiones y las URLs que las sirven (Rendimiento → Consultas, activando el filtro de página para ver qué URL rankea cada query). De tu CMS o tu crawler: la lista de URLs con H1 y title. Construye una tabla con columnas: Query | URL que rankea | H1 de esa URL | Posición media. Para cuantificarlo técnicamente, el G-Score de relevancia semántica mediante embeddings permite medir el alineamiento real entre una query y cada página del sitio.

Eres un especialista SEO en diagnóstico de canibalización. Analiza esta tabla para detectar competencia interna entre URLs y genera un plan de resolución priorizado.

PRINCIPIO CLAVE:

Si dos queries comparten más del 60-70% de URLs en el top 10 de Google, el algoritmo las trata como la misma búsqueda. Tenerlas en páginas separadas divide la autoridad en lugar de multiplicarla. Este SERP overlap es el indicador más fiable de canibalización real, más que la similitud semántica superficial.

TIPOS DE CANIBALIZACIÓN A DETECTAR:

TIPO A — Competencia directa por intención:

Dos o más URLs rankean para queries con la misma intención y entidad principal.

Señales: la posición de cada URL fluctúa, el tráfico se divide entre ambas, el CTR combinado es bajo.

Resolución: consolidar (301 de la débil a la fuerte), diferenciar (separar intenciones claramente) o eliminar.

TIPO B — URL incorrecta posicionando:

Una query relevante está siendo atendida por una página que no es la más indicada del sitio (ej: una categoría posicionando para una query que debería resolver un artículo específico).

Resolución: reforzar la URL correcta con enlazado interno desde las páginas adyacentes; revisar canonical.

TIPO C — Fragmentación de intención en una sola URL:

Una página acumula queries con intenciones contradictorias (informacional + transaccional). Indica que el sitio no tiene la página transaccional correspondiente o que la página intenta cubrir demasiado.

Resolución: separar en dos URLs con intenciones bien delimitadas.

TIPO D — Hueco de contenido:

Queries con volumen relevante para las que ninguna URL del sitio tiene cobertura adecuada.

Resolución: crear contenido nuevo con la intención correctamente alineada al SERP.

PARA CADA CASO DETECTADO DEVUELVE:

- Cluster semántico afectado

- Tipo (A / B / C / D)

- URLs involucradas con métricas (posición, impresiones, clics)

- Severidad: ALTA (tráfico dividido claramente, posición inestable) / MEDIA / BAJA

- Plan de resolución: acción concreta + URL que se mantiene como principal + qué pasa con las demás

- Impacto estimado: tráfico consolidado esperado si se resuelve

Ordena los casos por severidad y luego por volumen de impresiones afectadas.

RESUMEN FINAL:

- Total de casos por tipo

- Top 3 casos prioritarios por impacto potencial

- Estimación de tráfico recuperable si se consolidan los casos ALTA

DATOS (Query | URL que rankea | Clics | Impresiones | Posición media | H1 de la URL):

[PEGA AQUÍ]Output esperado: en sitios de tamaño medio, el modelo detecta habitualmente 3-8 clusters con canibalización real. Lo útil no es el listado de problemas sino la acción diferenciada por tipo: consolidar no es lo mismo que diferenciar, y el modelo distingue cuándo aplica cada uno.

Escenario 4: reescritura masiva de titles y meta descriptions

Preparación de datos: con tu crawler extrae las columnas URL, title, longitud del title, meta description y longitud de la meta description, filtrando solo páginas indexables con status 200. Para sitios con más de 500 URLs trabaja por secciones (blog, categorías, productos) en prompts separados para mantener la calidad del output.

Eres un especialista en SEO on-page y copywriting de conversión. Analiza estos titles y meta descriptions, detecta los patrones problemáticos y genera rewrites listos para implementar.

CONTEXTO DEL SITIO:

- Sector / temática: [describe el sitio]

- Objetivo principal: [ ] Mejorar CTR orgánico [ ] Aparecer en AI Overviews [ ] Aumentar conversión desde SERP

PATRONES CRÍTICOS EN TITLES (reescribir siempre):

- Duplicados exactos o casi exactos entre páginas distintas

- Ausentes o vacíos

- No incluyen la keyword principal o entidad central de la página

- Genéricos sin diferenciador ("Inicio", "Blog", "Categoría sin nombre")

- Empiezan por nombre de marca en páginas no-navegacionales (desplaza la keyword al final)

- Longitud >65 caracteres (truncado en desktop) o <30 caracteres

PATRONES RELEVANTES EN TITLES (reescribir si hay capacidad):

- Keyword al final del title en lugar de en los primeros 4-5 caracteres

- Sin diferenciador concreto: número, beneficio, año, formato ("Guía", "Comparativa", "Tutorial")

- Estructura idéntica a los competidores del top 5 sin ventaja diferencial

PATRONES CRÍTICOS EN META DESCRIPTIONS:

- Ausentes o vacías

- Duplicadas entre páginas distintas

- Repiten literalmente el title sin añadir información nueva

PATRONES RELEVANTES EN META DESCRIPTIONS:

- Longitud >155 caracteres

- Sin beneficio explícito para el usuario ni CTA implícito

- Redactadas para el algoritmo, no para el clic humano

REGLAS PARA LOS REWRITES:

Title: máx. 55 caracteres | keyword en los primeros 4-5 palabras | diferenciador concreto | sin artículos ni relleno al inicio

Meta description: máx. 145 caracteres | beneficio principal en la primera frase | CTA implícito ("Aprende", "Descubre", "Compara"...) | refleja exactamente la intención de búsqueda

Para ambos: usa frases directas y declarativas — funcionan mejor como citas en AI Overviews.

OUTPUT POR URL CON PROBLEMA:

| URL | Problema detectado | Title actual | Title reescrito | Meta actual | Meta reescrita |

Ordena: primero titles duplicados/ausentes (mayor impacto), luego longitud problemática, luego el resto.

DATOS (URL | Title | Longitud title | Meta description | Longitud meta):

[PEGA AQUÍ]Output esperado: rewrites listos para implementar en WordPress o en tu herramienta SEO. En sitios con más de 100 páginas, este proceso —que manualmente llevaría días— el modelo lo resuelve en minutos con una calidad suficiente para publicar tras una revisión rápida de los casos más estratégicos.

Construir el plan de acción desde los outputs

Los cuatro escenarios generan listas de problemas. El error habitual es intentar resolverlos todos a la vez. Este prompt convierte el volumen de hallazgos en un roadmap ejecutable:

Eres un consultor SEO senior. Convierte estos hallazgos de auditoría en un plan de acción ejecutable para los próximos 90 días usando una matriz impacto/esfuerzo para priorizar.

CONTEXTO:

- Sitio: [tipo, sector, tamaño aproximado]

- Tráfico orgánico actual: [X visitas/mes]

- Objetivo principal (elige uno):

[ ] Recuperar tráfico perdido

[ ] Mejorar CTR orgánico

[ ] Reducir problemas técnicos críticos

[ ] Ampliar topical authority

[ ] Aparecer en AI Overviews

- Recursos disponibles: [X horas SEO/semana] · [¿desarrollador disponible? sí/no] · [X artículos/mes]

INSTRUCCIÓN DE PUNTUACIÓN:

Para cada hallazgo de la auditoría calcula:

- Impacto (1-10): cuánto mueve en tráfico, rankings o conversión si se resuelve

- Esfuerzo (1-10): cuánto tiempo y coordinación requiere (1 = menos de 1 hora, 10 = proyecto de meses)

- Ratio de prioridad = Impacto ÷ Esfuerzo → mayor ratio = ejecutar antes

ESTRUCTURA DEL PLAN:

SEMANA 1 — Quick wins (ejecución el mismo día, menos de 1h cada acción):

→ Solo ítems con Impacto ≥7 y Esfuerzo ≤2

SEMANAS 2-4 — Alto impacto, esfuerzo moderado:

→ Impacto ≥6, Esfuerzo ≤5

SEMANAS 5-8 — Proyectos con planificación o coordinación:

→ Impacto ≥5, cualquier nivel de esfuerzo

SEMANAS 9-12 — Mejoras estructurales a medio plazo:

→ Proyectos de contenido, arquitectura o autoridad

PARA CADA ACCIÓN DEL PLAN DEVUELVE:

| Semana | Acción concreta | URLs afectadas | Tipo | Impacto | Esfuerzo | Ratio | Ejecuta | KPI a 30 días |

Donde "Tipo" puede ser: Técnico · On-page · Contenido · Enlazado interno · Automatizable con agente

Donde "Ejecuta" puede ser: SEO · Desarrollador · Redactor · Agente IA

AL FINAL INCLUYE:

- Resumen: número de acciones y horas estimadas por semana

- Top 3 acciones con mayor ratio (para presentar al equipo o cliente)

- Lista de acciones 100% automatizables con un script o agente

HALLAZGOS DE AUDITORÍA:

[PEGA AQUÍ EL OUTPUT DE LOS ESCENARIOS ANTERIORES]Este último paso es el que más tiempo ahorra en la práctica. Pasar de «tenemos 200 problemas» a «estas son las 15 acciones que hacemos este mes, en este orden y con estos responsables» es exactamente el tipo de trabajo de síntesis para el que la IA da el mejor resultado.

GEO, AIO y LLMO: SEO aplicado a las superficies de IA

GEO y AIO no son disciplinas nuevas que reemplacen al SEO. Son especializaciones del SEO aplicadas a nuevas superficies de visibilidad: las respuestas generativas de ChatGPT, Perplexity, Gemini o los AI Overviews de Google. Los fundamentos son exactamente los mismos —autoridad, estructura, E-E-A-T, utilidad real— con ajustes de formato para que el contenido sea extraíble por los modelos.

La distinción útil no es «SEO tradicional vs GEO». Es entender que hay superficies adicionales donde también importa aparecer, y que el buen SEO ya cubre el 80% del camino. GEO (Generative Engine Optimization) agrupa las tácticas para que el contenido sea citado en respuestas generativas. AIO (AI Overview Optimization) es su versión específica para los AI Overviews de Google. Ambas son extensiones naturales del trabajo SEO, no una rama aparte que exija empezar de cero. Si quieres profundizar en la capa técnica para LLMs y RAG, la guía de SEO para LLM de este blog cubre esa dimensión en detalle.

Por qué importa: como se señaló al inicio de esta guía, Los datos de 2025-2026 son ya contundentes: el CTR orgánico cae un 61% en queries donde aparece un AI Overview (Seer Interactive, septiembre 2025), y grandes publicaciones tech han perdido de media un 58% de tráfico desde sus máximos históricos. El 48% de las búsquedas en Google ya activan AI Overviews (febrero 2026). El contenido que no está optimizado para extracción generativa está perdiendo visibilidad real, aunque mantenga el ranking en la SERP clásica.Las tácticas concretas son en su mayoría prácticas SEO bien ejecutadas aplicadas a este canal:

- Answer-first structure: respuesta directa y completa en los primeros párrafos. Los modelos priorizan el contenido que responde la pregunta sin rodeos —exactamente lo mismo que lleva años pidiendo Google.

- Schema markup: FAQ schema para preguntas frecuentes, Article schema con autoría marcada, HowTo schema para procesos paso a paso. No es nuevo: es SEO técnico aplicado a señales que los LLMs también leen.

- E-E-A-T reforzado: autoría visible, citas a fuentes primarias con fecha, datos verificables. Los LLMs prefieren fuentes con señales de autoridad claras —las mismas señales que Google lleva años pidiendo.

- Consistencia de entidad de marca: presencia coherente en G2, Crunchbase, LinkedIn, medios del sector y Wikipedia si aplica. Los LLMs construyen su imagen de una marca cruzando múltiples fuentes —y eso también es trabajo de SEO de marca.

Herramientas para monitorizar visibilidad en LLMs: Otterly AI para menciones en ChatGPT, Perplexity y Gemini; AthenaHQ para AI Overviews y share of voice; Peec AI para presencia en respuestas generativas.

Stack mínimo viable: Claude y los datos que ya tienes

No necesitas gastar dinero en herramientas para trabajar bien. Necesitas un proceso claro y datos de calidad. Este es el stack que funciona para la mayoría de proyectos sin suscripciones innecesarias:

| Tarea | Herramienta | Coste |

|---|---|---|

| Datos de rendimiento SEO | Google Search Console | Gratis |

| Análisis de comportamiento | Google Analytics 4 | Gratis |

| Crawl técnico | Screaming Frog (hasta 500 URLs) | Gratis |

| Análisis, clustering, briefs, QA | Claude Pro o ChatGPT Plus | ~20€/mes |

| Tracking sistemático de posiciones | SE Ranking / Ahrefs / Semrush | Pago (si el volumen lo justifica) |

| Visibilidad en motores de IA | Otterly.ai / AthenaHQ | Pago (si la visibilidad en IA es prioritaria) |

El principio de este stack: antes de añadir una herramienta nueva, pregúntate si esa tarea la puedes hacer con Claude + datos de GSC/GA4. La mayoría de las veces la respuesta es sí.

Cuando el volumen de trabajo crezca o las necesidades de reporting lo justifiquen, se pueden añadir herramientas. Pero el coste de entrada para hacer buen SEO con IA es mucho más bajo de lo que el mercado quiere venderte.

Cómo medir el impacto de la IA en tu estrategia SEO

Si no mides, no sabes si está funcionando. Los KPIs que realmente importan cuando integras IA en el flujo SEO:

- Velocidad de producción: artículos publicados por semana antes y después de integrar IA. Si no ha aumentado manteniendo la calidad, el sistema no está funcionando.

- Tasa de rechazo en QA: porcentaje de artículos que no pasan revisión antes de publicarse. Si sube después de integrar IA, el proceso de generación tiene un problema estructural.

- Rendimiento comparativo: CTR, posición media y tráfico a los 90 días de artículos producidos con IA vs. sin IA. La métrica más honesta para evaluar si la calidad se mantiene.

- Visibilidad en AI Overviews: en GSC, filtra por «Tipo de búsqueda → IA» para ver en qué queries tu sitio aparece en AI Overviews. Señal emergente pero ya trazable desde la propia consola de Google.

Para el seguimiento de rendimiento comparativo puedes usar directamente Claude con exports de GSC:

Aquí tienes el rendimiento de mis artículos en GSC (últimos 90 días):

[CSV con URL, clics, impresiones, CTR, posición media, fecha de publicación]

Separa los artículos en dos grupos:

- Publicados antes de [FECHA en que empezaste a usar IA en producción]

- Publicados después de esa fecha

Compara CTR medio, posición media y clics totales entre ambos grupos.

¿Hay diferencias estadísticamente relevantes? ¿Qué conclusiones se pueden extraer?

¿Algún artículo del grupo IA destaca negativamente o positivamente? ¿Por qué podría ser?Riesgos y errores comunes al hacer SEO con IA

Confundir velocidad con calidad. Publicar más rápido no es el objetivo. El objetivo es posicionar mejor. Si el proceso de IA genera contenido más rápido pero con menor calidad editorial, el resultado neto es negativo.

Automatizar tareas que exigen criterio. La IA puede sugerir qué keywords atacar, pero la decisión estratégica requiere humano. La señal de que una tarea exige criterio: si el error en esa tarea tiene consecuencias difíciles de revertir, no se delega al sistema.

Validar poco. El output de un modelo de lenguaje siempre requiere revisión. Siempre. El nivel de revisión puede variar —más exhaustivo en contenido técnico, más ligero en clasificaciones de keywords—, pero nunca desaparecer.

Sobredepender de una sola herramienta. El mercado de herramientas de IA para SEO está en plena ebullición. Las plataformas cambian, los precios cambian, las funciones cambian. Un stack con dependencia excesiva en una sola herramienta es frágil.

Homogeneización del contenido. Cuando todos los equipos usan los mismos prompts y las mismas herramientas, el contenido tiende a parecerse. La ventaja competitiva viene de prompts propios refinados con criterio editorial, voz de marca definida y revisión humana real. Sin eso, la IA produce el promedio del mercado, no la diferenciación.

FAQ: preguntas frecuentes sobre SEO con IA

¿Google penaliza el contenido generado por IA?

No penaliza el contenido generado por IA per se. Su posición oficial desde 2023 es que el foco está en la calidad del contenido, no en cómo se produce. Lo que sí penaliza es el contenido de baja calidad, sin E-E-A-T y sin valor real para el usuario, independientemente de si lo escribió un humano o un modelo. La IA genera riesgo solo cuando se publica sin revisión o a escala sin criterio.

¿Qué herramientas de IA son mejores para SEO en 2025?

Antes de pagar por nada: Google Search Console, Google Analytics 4, Screaming Frog (gratis hasta 500 URLs) y Claude Pro o ChatGPT Plus. Con ese stack cubres análisis, clustering, briefs, QA y auditoría técnica. Si el volumen lo justifica, añade un buen tracker de keywords (SE Ranking, Ahrefs o Semrush) y un tracker de visibilidad en IA (Otterly.ai o AthenaHQ). El resto —Frase, Surfer SEO, Keyword Insights— son aceleradores opcionales, no requisitos.

¿Puede la IA reemplazar a un SEO?

No en el corto y medio plazo. Puede automatizar tareas mecánicas —clasificación, agrupación, detección de patrones, generación de borradores— pero la estrategia, la priorización, el criterio editorial y la comprensión del contexto de negocio siguen siendo trabajo humano. La IA reemplaza horas de trabajo mecánico, no el juicio estratégico.

¿Cuánto tráfico puede perderse por el auge de la IA generativa?

Los datos reales ya muestran el impacto: el CTR orgánico cae un 61% en queries donde aparece un AI Overview (Seer Interactive, septiembre 2025), y las grandes publicaciones tech han perdido de media un 58% de tráfico desde sus máximos.

El impacto es heterogéneo: el contenido informacional genérico es el más vulnerable; el contenido con alto E-E-A-T, datos propios y perspectiva experta es más resistente y tiene más probabilidades de ser citado por los propios LLMs.

¿Qué es GEO y cómo se relaciona con el SEO?

GEO (Generative Engine Optimization) es una especialización del SEO, no una disciplina aparte. Agrupa las tácticas para que el contenido aparezca citado en respuestas generativas —ChatGPT, Perplexity, Google AI Overviews— además de en los resultados de búsqueda clásicos. Las señales que importan son las mismas que trabaja el SEO: autoridad, estructura, E-E-A-T, utilidad real. La diferencia es el canal de destino. Un contenido bien construido en SEO tiene la mayor parte del camino andado para GEO; solo necesita ajustes de formato para que los modelos puedan extraer y citar su contenido con facilidad.

¿Cómo empezar a usar IA en SEO sin riesgo?

Empezar por tareas de research y clasificación —las más seguras porque el error es fácil de detectar y corregir— con validación humana de outputs. Nunca publicar contenido sin revisión. Construir el proceso en capas: primero keyword research, luego briefs, luego QA, luego auditorías. Cada capa que funciones bien da confianza para la siguiente.

Por dónde entrar y qué no delegar

La forma más eficiente de entrar es por donde hay más dolor: si el problema es ausencia de contenido, empieza por el flujo de clustering y brief; si el contenido existe pero no rinde, empieza por GSC y el Escenario 2 de auditoría.

Lo que no cambia con la IA es el criterio. El modelo no sabe qué keywords merece la pena atacar según tu negocio, no detecta si un artículo encaja con la voz editorial del sitio y no puede verificar si un dato es factualmente correcto. Esas tres cosas siguen siendo trabajo humano. Lo que sí cambia es la escala: el análisis que antes tardaba días ahora tarda horas, y los flujos que antes requerían un equipo ahora puede diseñarlos y ejecutarlos una sola persona.

Si tienes que elegir un único punto de entrada: exporta desde GSC las páginas de los últimos 90 días con clics, impresiones, CTR y posición media, y pásalas al prompt del Escenario 2 de esta guía. En veinte minutos tienes un diagnóstico priorizado con acciones concretas. Ahí empieza el SEO con IA aplicado con criterio.

Para seguir profundizando: la guía de SEO para LLMs cubre la optimización técnica para motores generativos; y este análisis sobre vectorización semántica explica cómo los modelos calculan la relevancia que usan para priorizar qué contenido citar.