Los motores de búsqueda y asistentes conversacionales basados en Modelos de Lenguaje (LLM) están transformando la forma en que los usuarios obtienen información.

Herramientas como ChatGPT, DeepSeek o Gemini utilizan modelos avanzados para responder directamente a las consultas, a veces complementados con recuperación de información externa (lo que se conoce como RAG, Retrieval-Augmented Generation).

Estas “respuestas generativas” presentan un nuevo reto para el SEO: ya no se trata solo de aparecer en una lista de enlaces azules, sino de ser referenciado o citado dentro de la respuesta que ofrece el chatbot.

Si el punto de partida es el SEO con IA como metodología general —cómo usar modelos de lenguaje en keyword research, auditorías y producción de contenido— la guía de SEO con IA ofrece ese marco completo antes de bajar a la capa técnica de LLMs y RAG. Si en cambio el objetivo es posicionar un producto o servicio de IA, la guía de SEO para productos de IA aborda ese caso específico.

A este conjunto de técnicas SEO orientadas a conseguir visibilidad en sistemas de IA se le denomina LLMO (Large Language Model Optimization): no es una disciplina nueva ni independiente, sino una especialización del SEO que adapta sus fundamentos al contexto de los modelos de lenguaje.

Existe una alternativa más inteligente a RAG, llamada SEARCH-R1. Si quieres saber más puedes consultar este artículo: SEARCH-R1 vs RAG en recuperación de información para LLMs

Estudios recientes destacan que los LLM pueden responder correctamente hasta el 80% de las preguntas en dominios especializados, superando a los buscadores tradicionales (que aciertan entre 50–70%) .

Índice de contenidos

LLM vs. RAG: ¿Qué cambia en el SEO?

Antes de profundizar en las estrategias, es importante entender las diferencias entre un LLM “puro” y un LLM con RAG, ya que influyen en cómo optimizar el contenido:

Chatbots LLM sin RAG (modelos cerrados)

Son modelos entrenados con un gran corpus hasta cierta fecha (por ejemplo, ChatGPT-4 entrenado hasta 2021). Responden con base en su conocimiento interno, sin buscar información nueva en la web. ¿Qué implica para el SEO? Que no pueden indexar contenido publicado después de su fecha de corte, y solo citarán el conocimiento absorbido durante su entrenamiento.

Para aparecer en sus respuestas, tu contenido debe haber sido ampliamente accesible y reconocido antes (por ejemplo, en Wikipedia, en sitios de alta autoridad o como parte del conjunto de entrenamiento). La optimización aquí es indirecta: asegurarse de tener presencia en fuentes reputadas que el modelo haya ingerido (un ejemplo clásico es Wikipedia o bases de conocimiento). Sin embargo, con modelos cerrados hay poco control inmediato; como señalan expertos, si el LLM no utiliza búsqueda, “toca tener paciencia” hasta que sea reentrenado con contenido más reciente.

Chatbots LLM con RAG (modelos con búsqueda integrada)

Integran un motor de búsqueda o base de datos vectorial que recupera contenido actualizado y específico para la consulta, que luego el LLM resume o cita. Ejemplos: Bing Chat (que busca en Bing y cita fuentes), el modo Navegador de ChatGPT o buscadores especializados como Perplexity.ai.

Implicaciones para el SEO

Aquí sí importa el SEO tradicional, porque para que el LLM te cite, primero debe encontrar tu contenido mediante su mecanismo de búsqueda. En la práctica, optimizar para un LLM con RAG es similar a optimizar para el buscador subyacente. Un profesional resume: en modelos RAG “debes centrarte en SEO, pues usan resultados de búsqueda que luego el LLM emplea para dar la respuesta”

Es decir, si quieres que Bing Chat mencione tu sitio, debes rankear bien en Bing; si es el AI de Google (SGE, Search Generative Experience), debes estar en el índice de Google y contar con buen posicionamiento. La gran diferencia es que el usuario puede no ver tu enlace directamente –quizá solo vea un fragmento citado–, por lo que el contenido debe ser lo suficientemente relevante y confiable para que el LLM lo incluya en su síntesis.

EEAT, la piedra angular

En ambos casos, la autoridad y calidad del contenido juegan un papel central. Las IA tienden a favorecer fuentes fiables para minimizar información errónea. De hecho, Google ha ajustado sus sistemas para que los resúmenes de IA prioricen contenido de sitios con alta autoridad y experiencia (E-E-A-T).

Un estudio de BrightEdge a finales de 2024 reveló que en las respuestas generativas de Google (AI Overviews), el 72% de las respuestas sobre salud provienen de centros médicos e instituciones de investigación líderes, frente al 54% a inicios de ese año.

Es un aumento notable que muestra cómo la IA consolida sus fuentes hacia sitios de confianza. En tecnología B2B ocurre algo similar: entre 15% y 22% de las respuestas de IA en consultas tecnológicas provienen de solo cinco grandes empresas (por ejemplo, Amazon, IBM, Microsoft).

Esta concentración exige que, si no eres ya una de esas autoridades, adaptes tu estrategia para ganar relevancia o colaborar con fuentes reconocidas.

Cómo cambia el foco del SEO cuando el destino son los LLMs

Las bases del SEO —contenido relevante, optimización técnica, autoridad mediante enlaces— siguen siendo las mismas. Lo que cambia es el escenario de consumo del resultado: en lugar de un clic en una SERP, el usuario lee una respuesta generada. A continuación, se muestra cómo evoluciona el foco en cada táctica:

- Visibilidad de resultado: En el SEO tradicional el objetivo es estar en el Top 10 (idealmente en el Top 3) de la página de resultados (SERP) para captar clics. En el SEO para LLM, el objetivo es estar entre las fuentes que el modelo utiliza o cita en su respuesta. No basta con rankear alto; si el contenido no aporta valor específico a la consulta, el LLM podría omitirlo, aunque esté en la primera página.

Por ejemplo, Bing Chat puede leer los principales resultados de Bing pero citar solo uno o dos que contengan la respuesta exacta. Por ello, es crucial tener contenido directamente útil (snippet-ready). En Google SGE, la IA extrae fragmentos tipo featured snippet de páginas bien posicionadas, pero con mayor énfasis en la precisión contextual. Como dijo un experto: «La claridad y utilidad de tu contenido es lo que finalmente hace que una IA lo seleccione.»

- Clicks vs. respuestas directas (zero-click): En la búsqueda tradicional, un buen snippet atrae clics hacia tu web. Con los LLM, el usuario puede obtener la respuesta sin salir del chat, entrando en la era del “zero-click” potenciado por IA, lo que reduce el tráfico directo a las webs. Gartner predice que hasta el 50% del tráfico de búsqueda tradicional podría perderse en tres años. Sin embargo, los LLM pueden generar tráfico derivado cuando incluyen enlaces.

Por ejemplo, de Q3 a Q4 de 2024 hubo un aumento del 800% en tráfico referido desde chats LLM. Un colega comentó: «Ser citado por la IA es tan valioso como recibir un clic directo, pues refuerza la autoridad de la marca.»

- Palabras clave vs. intención y contexto: El SEO tradicional se centraba en palabras clave específicas y su densidad. Con los LLM, el énfasis se desplaza hacia la intención y el contexto, ya que los modelos entienden lenguaje natural, sinónimos y matices semánticos. Por ello, cubrir bien un tema es fundamental: incluir definiciones, responder preguntas relacionadas, y abordar causas y consecuencias. U

Un estudio reveló que “contenido profundo y bien estructurado que responde a múltiples facetas de una consulta tiene mayor probabilidad de ser seleccionado por un LLM”.

- Link building vs. Menciones y entidades: Mientras que el link building tradicional sigue siendo importante, en el contexto de los LLM unas buenas menciones pueden valer más que muchos backlinks. Si tu marca es referenciada positivamente en diversas fuentes relevantes, el LLM podría integrarla en sus respuestas.

Por ejemplo, se observa que en ciertas consultas de software de gestión, los LLM citan productos que aparecen en múltiples rankings de terceros, aunque su propio sitio no esté en el primer puesto. Esto refuerza la importancia de trabajar en la visibilidad de marca y la presencia en entidades reconocidas del Knowledge Graph de Google. Un experto resumió: «Las menciones consistentes en fuentes de autoridad pueden superar a los backlinks tradicionales.»

- Metaetiquetas y rich snippets vs. datos para IA: En el SEO tradicional se utilizan titles, metadescriptions y marcado schema.org para destacar. Con las respuestas generativas, el usuario puede no ver la metadescripción, ya que lo importante es el contenido procesado por la IA. Sin embargo, el marcado estructurado sigue siendo clave para facilitar la extracción de respuestas. Por ejemplo, definir preguntas y respuestas con

<script type="application/ld+json">puede ayudar a que tu contenido sea interpretado correctamente. Un estudio explicó: «El marcado correcto permite a la IA extraer la respuesta de forma precisa, mejorando la relevancia del snippet.» - Actualización y frescura: Google solía recompensar contenido fresco para ciertas intenciones de búsqueda. Para LLM con RAG, la relevancia en tiempo real es fundamental. Si la consulta implica información cambiante (tendencias, precios, noticias), los LLM priorizarán contenido reciente. Por ello, mantener tus artículos actualizados (con nuevas fechas, datos y “última actualización”) es esencial. Un estudio demostró que “la frescura del contenido se traduce en mayor confianza por parte de la IA”.

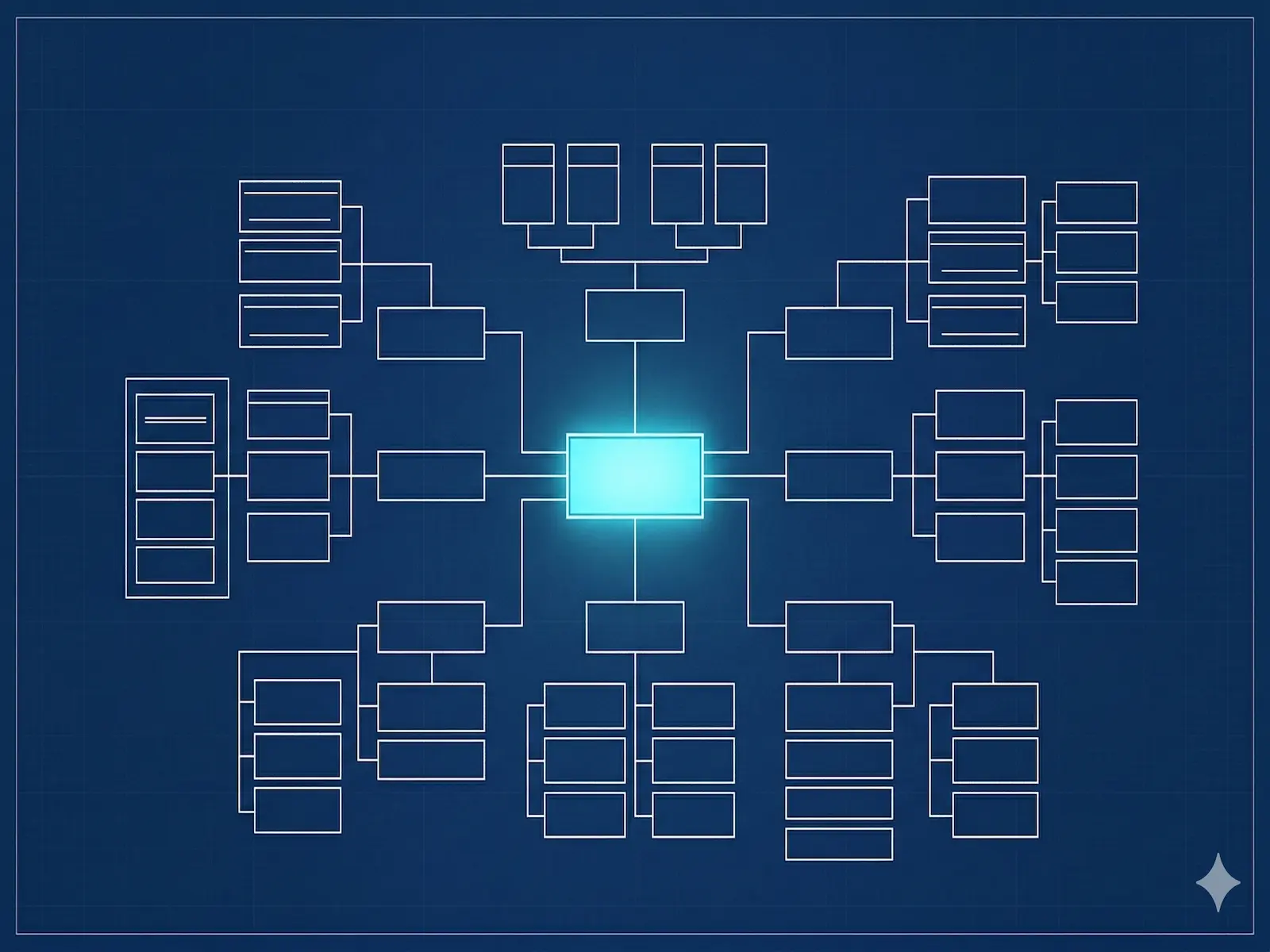

Aleyda Solis compartió este gráfico, que muestra las diferencias y similitudes entre ambas, considerando: los criterios de comportamiento del usuario al buscar, las áreas de optimización, y los objetivos y métricas. Como se puede ver, existe una gran superposición entre ambas estrategias, aunque las principales diferencias se encuentran en el comportamiento del usuario al realizar búsquedas.

| Comportamiento de Búsqueda del Usuario | Áreas de Optimización | Objetivos y Métricas |

|---|---|---|

|

CRITERIO Consultas populares (short-tail), alta competencia, el usuario busca información rápida o amplia. Valora autoridad y relevancia. | Enfoque semántico y específico. Uso de palabras clave competitivas de alto volumen. Construcción de autoridad y enlaces. Contenido de alta calidad. |

Búsqueda Tradicional: Tráfico, posicionamiento, CTR, engagement. Búsqueda con IA: Cobertura en prompts, menciones de marca, fuentes citadas, reconocimiento en respuestas de IA. |

|

INTENCIÓN DE BÚSQUEDA Y COMPLEJIDAD Consultas más largas o específicas. El usuario busca respuestas detalladas (“cómo”, “por qué”, etc.). Puede requerir profundidad. | Investigación de palabras clave long-tail. Contenido profundo y segmentado. Optimización semántica y clústeres temáticos. Uso de FAQs y guías extensas. |

Búsqueda Tradicional: Conversión, ingresos, ROI. Búsqueda con IA: Engagement interactivo, menciones de marca en respuestas, satisfacción del usuario, tiempo de conversación. |

|

CONSULTAS LOCALES / GEO El usuario busca información de ubicación específica: direcciones, horarios, reseñas, proximidad, etc. | SEO local (Google Business Profile), consistencia NAP (Nombre, Dirección, Teléfono), reseñas, Map Pack, páginas de ubicación, datos estructurados locales. |

Búsqueda Tradicional: Visitas a la tienda, llamadas, leads locales. Búsqueda con IA: Sugerencias hiperlocales, integración en mapas y conocimiento de IA, indicaciones directas, reseñas destacadas. |

|

CONSULTAS TRANSACCIONALES / DE PRODUCTO / DE MARCA El usuario desea comprar, comparar productos o conocer más sobre una marca específica. Búsqueda enfocada en decisión de compra. | E-E-A-T (Experiencia, Pericia, Autoridad, Confiabilidad). Autoridad de marca y Knowledge Graph. Optimización de páginas de producto y contenidos transaccionales. |

Búsqueda Tradicional: Ventas, reconocimiento de marca, lealtad. Búsqueda con IA: Respuestas directas sobre productos, preferencia de marca, menciones en chats de IA, conversiones en entornos conversacionales. |

|

AMPLITUD Y PROFUNDIDAD / TIEMPO Y VELOCIDAD / RESPUESTAS INMEDIATAS El usuario puede necesitar información extensa o soluciones rápidas. Interesa contenido en distintos formatos (texto, voz, video) y velocidad de carga. | Datos estructurados (schema), optimización para voz, velocidad de página, UX móvil, contenido de respuesta rápida (snippets, FAQs), multimedia. |

Búsqueda Tradicional: Tasa de rebote, retención, visibilidad en fragmentos destacados. Búsqueda con IA: Métricas de cero clic, conversiones vía voz/chat, presencia en snippets de IA, satisfacción inmediata. |

|

E-E-A-T Y CONFIANZA DEL USUARIO El usuario valora experiencia, pericia, autoridad y confiabilidad. Espera contenido verificado y seguro. | Refuerzo de señales de autoridad (reseñas, testimonios, acreditaciones). Datos del autor, transparencia de fuentes, cumplimiento de directrices de IA y SEO. |

Búsqueda Tradicional: Credibilidad, reputación, calificaciones y reseñas. Búsqueda con IA: Menciones de marca confiable en respuestas, reducción de “alucinaciones” de IA, satisfacción del usuario. |

V1, 4 de abril de 2025 – Creado por Aleyda Solis – Consultora SEO.

Agradecimientos especiales a Freedman Consulting por la asistencia en prompts y a Chris Green.

Factores clave de ranking en respuestas de LLM (con y sin RAG)

Aunque cada plataforma de IA tiene sus matices, existen una serie de factores comunes que determinan si tu contenido será seleccionado para una respuesta generativa:

1. Autoridad, experiencia y confianza (E-E-A-T): Al igual que en el SEO clásico, los LLM favorecen contenido de fuentes autorizadas en cada temática. La diferencia es que la IA busca reducir el riesgo de error y, por ello, confía aún más en «los de siempre». Investigaciones de 2025 muestran una concentración de fuentes en respuestas de IA: Google AI Overview prácticamente duplicó la proporción de respuestas tomadas de sitios muy fiables en verticales críticos como salud o finanzas. Por ello, trabajar el E-E-A-T es imprescindible. Esto implica incluir credenciales del autor, una política editorial clara, reseñas positivas, presencia en medios reconocidos y enlaces entrantes de calidad. Un ejemplo concreto es que Mayo Clinic y MedlinePlus han aumentado su visibilidad en respuestas sobre salud, ya que Google prefiere mostrar información médica de alta autoridad. Como afirmó un analista SEO: «La credibilidad es la moneda más valiosa en el ecosistema de IA.»

2. Relevancia semántica y cobertura del tema: Los LLM no se fijan únicamente en palabras clave; «entienden» la consulta y buscan contenido que responda exactamente a la necesidad informativa. Optimizar por relevancia semántica significa abordar el tema de forma completa: incluir definiciones, responder preguntas relacionadas, y cubrir causas y consecuencias si aplica. Un ejemplo: si se desea aparecer en la respuesta a «¿Cómo reducir la huella de carbono en casa?», un artículo que solo mencione “usar menos electricidad” es insuficiente; en cambio, uno que ofrezca varias estrategias (ahorro energético, reciclaje, uso de energía solar, dieta sostenible) resultará mucho más atractivo para la IA. Un experto puntualizó: «La profundidad temática y la estructura clara hacen la diferencia en respuestas generativas.» Si quieres cuantificar esa alineación de forma técnica, puedes calcular el G-Score mediante embeddings y dot product, el mismo mecanismo que usa Google RankEmbed internamente.

3. Formato y estructura de la información: El formato es clave para que un LLM entienda y extraiga tu contenido. Los chatbots valoran:

- Listas enumeradas o pasos secuenciales: Especialmente para consultas tipo «cómo hacer…». Google ha confirmado que las AI Overviews sobresalen al presentar instrucciones paso a paso, lo que aumenta la probabilidad de que la IA extraiga dichos pasos.

- Contenido conciso que va al grano: En consultas factuales, un párrafo introductorio que defina claramente el término es clave. Un ejemplo de éxito es Wikipedia, cuyo primer párrafo suele ser citado por modelos de lenguaje.

- Estructura de FAQ: Incluir una sección de preguntas frecuentes (FAQ) con respuestas breves permite cubrir variantes de la consulta y facilita que la IA detecte la respuesta exacta. Por ejemplo, si un usuario pregunta “¿X producto tiene garantía internacional?”, y tu web responde explícitamente esa pregunta, la IA extraerá ese fragmento.

- Secciones bien tituladas y segmentadas: Utiliza subtítulos claros para cada subtema. Esto no solo mejora el SEO, sino que también facilita que la IA identifique la información relevante. Un informe interno indicó que Google SGE a veces oculta partes irrelevantes para mostrar solo el fragmento pertinente.

4. Actualidad y real-time (frescura): La frescura del contenido es crítica para las respuestas de IA, especialmente en entornos RAG. Publicar y actualizar artículos con nuevos datos y fechas es esencial para que la IA seleccione tu contenido en consultas que requieren información actualizada. Como se afirma: «La capacidad de mantenerse actualizado es fundamental en el entorno dinámico de la búsqueda generativa.»

5. Datos, hechos y referencias: Incluir datos verificables, citas y referencias en tu contenido lo hace más “citeable” para la IA. Por ejemplo, un artículo que mencione “… según [Estudio X], el tráfico desde chatbots creció un 800% en el último trimestre de 2024” le proporciona a la IA cifras concretas para citar. Esto enriquece la credibilidad y aumenta la probabilidad de ser seleccionado. Tal estrategia ha sido señalada por expertos: «La inclusión de datos y referencias precisas no solo mejora el E-E-A-T, sino que convierte tu contenido en una referencia para la IA.»

6. Optimización técnica y accesibilidad para crawlers de IA: Es vital que tu sitio esté correctamente indexado y que los bots de IA puedan acceder a tu contenido sin restricciones. Asegúrate de no bloquearlos en el archivo robots.txt y ten en cuenta que los LLMs no renderizan JavaScript, por lo que un marcado HTML limpio y semántico (<article>, <h1>, <h2>, etc.). Un caso reportado mostró que páginas con etiqueta noindex fueron omitidas por ChatGPT, pese a tener buen ranking en Bing.

7. Sentimiento y tono apropiado: Los LLM valoran un contenido con tono neutral y profesional. Contenido extremista o muy parcial puede ser relegado. Mantén un tono equilibrado, profesional y útil. Por ejemplo, en una consulta sobre “mejor marca de coches eléctricos”, un artículo comparativo neutral será preferido a uno meramente promocional. Como resumió un especialista: «La objetividad y claridad en el tono son claves para ser seleccionado por los modelos generativos.»

Estrategias SEO optimizadas para LLM y RAG (con ejemplos)

A continuación, se presentan estrategias específicas para optimizar tu contenido para respuestas de chatbots con IA, acompañadas de ejemplos concretos y evidencia que respalda su efectividad en 2025:

1. Crear contenido con E-E-A-T reforzado y enfoque de marca/entidad

Estrategia: Potencia la Experiencia, Pericia, Autoridad y Confianza en tu sitio. Esto implica contar con autores expertos (mostrando sus credenciales), citar fuentes confiables, incluir testimonios o casos de uso y tener páginas institucionales claras (Sobre nosotros, Políticas, etc.). Paralelamente, trabaja el posicionamiento de tu marca como entidad reconocida: consigue una entrada en Wikipedia, reclama perfiles de empresa (Google Business Profile, Wikidata) y logra menciones en medios relevantes. Una campaña de branding efectiva refuerza el mensaje de la marca. Un colega comentó: «Establecer tu marca como entidad en el Knowledge Graph es crucial para que la IA la reconozca como fuente confiable.»

Ejemplo de implementación: Un sitio de finanzas personales crea un blog con artículos escritos por planificadores financieros certificados; cada post incluye una breve bio que menciona su certificación CFP. Además, la web crea una página en Wikidata y consigue apariciones en portales financieros de renombre. Como resultado, cuando los usuarios preguntan en Bing Chat “¿Cómo hacer un presupuesto mensual?”, la IA tiende a citar este sitio por considerarlo experto. Esta estrategia ha sido validada por expertos que señalan que una marca bien definida y reconocida es interpretada con mayor precisión por los modelos generativos.

2. Orientar el contenido a preguntas y conversación natural

Estrategia: Adapta tu contenido al estilo conversacional y de preguntas que los usuarios utilizan con los chatbots. Investiga keywords long-tail orientadas a preguntas (por ejemplo, “cómo”, “qué”, “cuál es la mejor forma de”) y estructura contenidos enteros como respuestas directas. Considera crear una sección de “Pregunta al experto” o “Q&A” en tu sitio, para posicionarte como fuente de respuestas.

Ejemplo de implementación: Una empresa de electrodomésticos mantiene en su web una base de conocimiento con preguntas como “¿Por qué mi lavadora hace ruido?” o “¿Cómo limpiar el filtro de aire acondicionado?”, presentadas en encabezados <h2> y seguidas de respuestas breves en listas o párrafos. Así, cuando un usuario pregunta, por ejemplo, “¿Cómo limpio el filtro del aire acondicionado LG?”, el LLM encuentra esa respuesta y la utiliza. Sitios como Stack Overflow han comprobado que este formato facilita que Bing Chat o ChatGPT citen sus respuestas. Un experto en SEO comentó: «El formato de preguntas y respuestas es el camino para adaptarse a la búsqueda conversacional.»

3. Proporcionar respuestas directas, concisas y fragmentables

Estrategia: Identifica las preguntas o temas principales en tu contenido y ofrece resúmenes breves y contundentes que sean fácilmente citables. Es ideal incluir answer snippets en el primer párrafo del artículo, que resuman la respuesta corta, para luego profundizar en detalles. Usa la regla inversa de la pirámide periodística (lo más importante primero) y resalta frases clave en negrita o entre comillas.

Ejemplo de implementación: Un blog técnico que desee ser fuente preferida podría estructurar su artículo sobre “¿Qué es el aprendizaje federado?” iniciando con: “Aprendizaje federado: es un método de entrenamiento de modelos de IA donde los datos permanecen en dispositivos locales y solo se comparten parámetros entrenados.” Luego, se incluiría una lista de “Características clave del aprendizaje federado”. Así, ante la consulta “ventajas del aprendizaje federado”, el chatbot extraería esos puntos. Sitios como Wikipedia y TechTarget son reconocidos por este formato.

Por qué funciona: Los LLM tienden a generar respuestas que van al grano y luego amplían. Si tu contenido tiene esa “gota” inicial bien formulada, el modelo lo aprovechará. Un estudio de SEJ destacó que Google utiliza la IA generativa para mantener la precisión en las respuestas al extraer definiciones claras de fuentes confiables.

4. Incorporar datos, estadísticas y contenido de apoyo que te hagan “citable”

Estrategia: Haz que tus páginas ofrezcan valor añadido a través de datos verificables, estudios de caso, citas de expertos o estadísticas únicas. Incluir referencias (por ejemplo, “según [Estudio X]”) enriquece la credibilidad y aumenta la posibilidad de ser citado por la IA.

Ejemplo de implementación: Un blog de marketing digital publica un artículo “Tendencias SEO 2025” que incluya datos como: “El tráfico generado por chatbots de IA creció un 800% entre Q3 y Q4 de 2024”, y añade: “BrightEdge observó AI Overviews en 25% de las búsquedas de más de 8 palabras, el doble que a mediados de 2024”. Estos datos se convierten en material para que un LLM responda a “¿Cómo está impactando la IA en SEO en 2025?”. Empresas de análisis como Previsible.io han capitalizado esta estrategia, publicando informes con gráficas y cifras que luego se reproducen en respuestas generativas.

5. Optimizar para Bing y otras plataformas emergentes de búsqueda AI

Estrategia: No concentres tus esfuerzos solo en Google. Bing, con su integración en ChatGPT, y otros motores de búsqueda AI (como Perplexity, You.com o asistentes tipo Alexa/Siri) requieren que optimices también para ellos. Esto implica indexar tu sitio en Bing Webmaster Tools, analizar tus rankings en Bing y adaptar tu contenido para alinearlo con las entidades que utiliza Bing en su Knowledge Graph.

Ejemplo de implementación: Un ecommerce que no logra el snippet de “mejor aspiradora 2025” en Google, pero sí en Bing, decide optimizar su página ajustando el título a un estilo más directo, agregando un párrafo inicial conciso y utilizando IndexNow para acelerar la indexación. Como resultado, Bing Chat comienza a citar la página en respuestas a consultas en inglés, generando doble visibilidad: en Bing Search y en Bing Chat/ChatGPT. Un experto resumió: «Atender al SEO en Bing puede abrirte puertas en el ecosistema de búsqueda AI.»

6. Aplicar la estrategia “Surround Sound”: estar presente en las fuentes que la IA consulta

Estrategia: Identifica las principales fuentes que los LLM utilizan para tu sector y trabaja para figurar en ellas mediante guest posts, participación en foros, colaboraciones y PR digital (conceptos relacionados con el ecosistema MCP-B y visibilidad en LLMs). La idea es que, si la IA consulta ciertos blogs o foros para respuestas, tu marca aparezca indirectamente en las respuestas generadas.

Ejemplo de implementación: Una startup de software SaaS descubre que en ChatGPT, al consultar alternativas a un competidor famoso, se citan 3 o 4 nombres, pero no el suyo. Mediante campañas de outreach y colaboraciones en artículos tipo “Top 10 alternativas a X”, logra que su producto sea mencionado en múltiples fuentes. Con el tiempo, Perplexity.ai y Bing Chat comienzan a incluir su herramienta en sus respuestas. Un experto afirmó: «Estar presente en múltiples fuentes es una estrategia ganadora para la búsqueda AI.»

7. Monitorear las menciones en LLM y adaptar la estrategia continuamente

Estrategia: Debido a la naturaleza dinámica de los LLM, es crucial establecer un sistema de monitorización continua. Usa herramientas especializadas (como LLM Radar o SEOVendor RankLens) y revisa manualmente las respuestas de chatbots a consultas importantes para tu sector. Ajusta tu estrategia en función de los cambios detectados.

Ejemplo de implementación: Una empresa de comercio electrónico nota que durante enero su blog era citado frecuentemente en respuestas de Bing Chat para guías de compra en su nicho. Sin embargo, en febrero las menciones disminuyen. Tras investigar, descubren que Google y Bing están refinando sus modelos de citación de IA por contexto. La empresa adapta su estrategia creando videos tutoriales complementarios a sus guías escritas y optimizándolos para YouTube, lo que recupera la visibilidad en las respuestas de IA. Un informe de BrightEdge resumió: «Monitorear y pivotar es clave para mantener la presencia en el entorno dinámico de la búsqueda AI.»

Herramientas y métricas: Algunas organizaciones están creando métricas propias para el SEO en IA, como el “Share of Voice en respuestas de LLM” o el “LLM referral traffic”. Se espera que este tráfico crezca hasta el 10% del total para fines de 2025. Esto permite ajustar la estrategia en función de cómo se menciona tu marca en las respuestas de la IA.

Cómo evolucionan las tácticas SEO en el contexto de los LLMs

Para resumir, se contrastan algunas tácticas clásicas de SEO con sus contrapartes adaptadas a la era de los LLM y RAG:

- Investigación de palabras clave: Antes se buscaban keywords exactas y variaciones. Ahora se investiga también sobre prompts y se analizan las preguntas que los usuarios hacen a la IA, optimizando por la intención conversacional.

- Contenido largo vs. contenido útil: El contenido extenso solía posicionar bien, pero ahora se valora la calidad sobre la cantidad. Es preferible escribir lo necesario para ser completo sin rellenar, estructurando el contenido para que un modelo pueda extraer lo esencial sin esfuerzo.

- Link building tradicional vs. building authority: Anteriormente se priorizaba conseguir enlaces; ahora se busca ganar autoridad y presencia, incluso sin enlaces directos, mediante relaciones públicas digitales y colaboraciones que posicionen a tu marca como referencia.

- CTR y metaetiquetas: El enfoque cambia, ya que el CTR se determina por si eres citado en la respuesta de la IA. Mantener títulos claros y descriptivos es crucial, así como optimizar la metadescripción para el análisis del buscador, aunque el usuario final no la vea directamente.

- Medición de éxito: Tradicionalmente se medía a través de rankings y clics, pero en la era LLM se añaden métricas de apariciones en respuestas y tráfico derivado desde asistentes, lo que hace al SEO más holístico.

Ejemplos de sitios que triunfan con estas prácticas

Para aterrizar lo anterior, se presentan algunos ejemplos reales de entidades que en 2025 han logrado destacar en resultados de IA aplicando estas mejores prácticas:

- Sitios médicos de alta autoridad (ej: Mayo Clinic, Cleveland Clinic) – Caso: Consultas de salud en chatbots. Gracias a su fuerte E-E-A-T, estos sitios acaparan la mayoría de las respuestas. Por ejemplo, si se pregunta “¿Síntomas de diabetes?”, la IA tiende a citar a Mayo Clinic por su alta credibilidad.

- Medios especializados y sitios con datos propios (ej: Statista, Our World in Data) – Caso: Preguntas que requieren cifras o comparativas. Estos sitios recopilan datos y visualizaciones que se utilizan como fuente principal en respuestas de IA. Por ejemplo, para la consulta “What percentage of X?”, la respuesta suele iniciar con “Según Statista, el X%…”.

- Foros y comunidades (ej: StackExchange, Reddit) – Caso: Resolución de problemas prácticos o recomendaciones de productos. Plataformas como Stack Overflow se citan frecuentemente en respuestas de LLM para consultas técnicas, dada su estructura de preguntas y respuestas.

- Empresas que adoptaron contenido multimodal (ej: Home Depot, Lowe’s) – Caso: Preguntas de “how-to” en bricolaje. Al integrar vídeos tutoriales junto con guías escritas, estos sitios logran que la IA incluya tanto texto como multimedia en sus respuestas, lo que incrementa la visibilidad.

- Marcas que cultivan el Knowledge Graph (ej: Tesla, Coca-Cola) – Caso: Consultas de comparación de productos. Estas marcas han invertido en consolidar su presencia digital y, como resultado, son citadas con datos precisos en respuestas de IA.

Crear contenido de calidad y de cómoda extración

La evolución hacia chatbots LLM y sistemas con RAG está redefiniendo las reglas del juego SEO en 2025. Los fundamentos de calidad y relevancia son más importantes que nunca, pero la forma de optimizarlos debe adaptarse al nuevo contexto: pensar en cómo la IA busca, selecciona y presenta la información. Las mejores prácticas incluyen crear contenido con autoridad y formato apto para extracción, incorporar datos que te hagan destacar, cuidar el aspecto técnico para ser accesible a los crawlers de IA y monitorizar constantemente el panorama cambiante de citaciones y fuentes.

Las investigaciones y estudios de 2025 refuerzan estas directrices: Google está afinando sus resúmenes de IA para que primen las fuentes más confiables, y los usuarios formulan consultas cada vez más largas y complejas que la IA maneja con sorprendente acierto.

De hecho, ya se habla de LLMs como “el front door de Internet”, sustituyendo en parte a la tradicional página de búsqueda. Ignorar esta tendencia no es opción; abordarla estratégicamente ofrece oportunidades para que marcas y sitios web ganen ventaja competitiva y visibilidad omnipresente en la experiencia informativa de los usuarios.

Aprende más sobre SEO para LLM

Mapa del cluster SEO + IA

Para ampliar esta parte del sistema, continúa por estas guías relacionadas: